Teknisk SEO är grunden för att din webbplats ska kunna hittas, förstås och indexeras av sökmotorer. Om tekniken inte fungerar på din webbplats så påverkar det din ranking negativt. Utan en stabil teknisk grund har du väldigt svårt att nå ut i sökresultaten och därmed begränsar dina chanser att placeras högt på dina viktigaste sökord. Teknisk SEO handlar om att bygga den infrastruktur som gör webbplatsen snabb, säker och begriplig för både människor och sökmotorer. I denna omfattande guide går vi igenom allt från grunderna till avancerade begrepp som crawlbudget, indexering, canonical-taggar och strukturerad data.

Snabba svar

- Teknisk SEO gör att din webbplats kan hittas, laddas snabbt och indexeras korrekt.

- Utan en bra teknisk SEO-grund riskerar ditt innehåll att ranka dåligt.

- Teknisk SEO påverkar både användarupplevelse och ranking direkt.

- Alla tekniska åtgärder har inte samma effekt på SEO.

Vad är teknisk SEO?

Teknisk SEO är den del av sökmotoroptimering (SEO) som handlar om att säkerställa att din webbplats fungerar ifrån ett tekniskt perspektiv för sökmotorer. Det innebär att göra sidorna tillgängliga, snabba och läsbara för sökrobotar så att de kan förstå, indexera och presentera ditt innehåll på bästa sätt. Den tekniska delen täcker allt från webbplatsens kod, serverinställningar och struktur till laddningstid, mobilanpassning och säkerhet. När teknisk SEO fungerar korrekt får sökmotorer en tydlig väg genom hela sajten, vilket ökar dina chanser för att ranka stabilt även när algoritmerna förändras.

Typer av problem som kan lösas med teknisk SEO

Typer av problem som kan lösas med teknisk SEO är sådana som hindrar både användare och sökmotorer från att förstå, läsa och värdera din webbplats korrekt. Nedan är de vanligaste problemen som löser sig genom teknisk SEO:

- Sidor som är dåligt mobilanpassade

- Sidor som laddar långsamt

- Trasig kod eller felaktig HTML

- Saknade viktiga taggar som titel, H1, meta-description eller canonicals

- Länkar som Google inte kan följa eller indexera

- Felaktig eller tung JavaScript-implementation som döljer innehåll

- Information som Google inte kan tolka eller rendera korrekt

- Bristfällig hantering av sidor som saknas eller flyttats (404, 410, redirects)

- Otydlig struktur och navigering som skapar orphan pages och förlorad länkstyrka

- Duplicerat innehåll som försvagar signalerna till rätt sida

Omfattningen av teknisk SEO

Omfattningen av teknisk SEO inkluderar alla tekniska faktorer som påverkar hur sökmotorer hittar, analyserar och tolkar din webbplats. Det rör områden som crawling, indexering, struktur, laddningshastighet, mobilvänlighet och säkerhet. Dessutom omfattar det styrning via robots.txt, sitemaps, kanoniska taggar (canonicals) och metadata som berättar för sökmotorer vilka sidor som ska prioriteras.

Hur skiljer sig teknisk SEO mot redaktionell SEO?

Skillnaden mellan teknisk SEO och redaktionell SEO är att teknisk SEO fokuserar på webbplatsens funktion medan redaktionell SEO handlar om innehållet. Den tekniska delen säkerställer att strukturen och koden gör det möjligt för Google att läsa sidan, medan den redaktionella delen avgör vad Google förstår och hur den uppfattar värdet av innehållet. Båda är väldigt viktiga och är i mångt och mycket beroende av varandra. Den tekniska SEO:n gör att sidan existerar i Googles ögon och den redaktionella gör att den förtjänar att ranka.

Vem behöver teknisk SEO?

Alla som driver en webbplats behöver teknisk SEO eftersom det påverkar synligheten oavsett sajtens storlek eller syfte. Det är inte längre ett område för enbart utvecklare eller stora företag; även små företag och bloggar behöver en fungerande teknisk grund för att kunna konkurrera på riktigt i sökresultaten.

När webbplatsen växer i omfång eller komplexitet ökar också de tekniska riskerna och ju tidigare man bygger rätt struktur desto lättare blir det att undvika kostsamma SEO-fel senare.

Små webbplatser

Små webbplatser behöver teknisk SEO för att undvika vanliga misstag som långsamma sidor, brutna länkar och duplicerat innehåll. För dessa sajter räcker det ofta med att ha ett snabbt webbhotell, en tydlig URL-struktur och ett korrekt SSL-certifikat. Det är bättre att bygga rätt från början än att behöva reparera tekniska problem när sidan redan har vuxit.

Större webbplatser

Större webbplatser behöver teknisk SEO för att hantera komplexitet, crawlbudget och indexeringsstyrning. När tusentals sidor uppdateras dagligen krävs logganalys, prioritering och tät uppföljning. Små tekniska misstag, som felaktiga canonical-taggar eller blockeringar i robots.txt, kan leda till att stora delar av webbplatsen försvinner ur index. För stora sajter blir teknisk SEO en löpande process snarare än ett engångsprojekt.

Hur sökmotorer fungerar

Sökmotorer fungerar genom att samla in, tolka, lagra och tillhandahålla information från hela webben. För att visa relevanta resultat arbetar de i flera steg, där varje steg påverkas (men inte uteslutande) av hur väl din webbplats fungerar tekniskt. De viktigaste faserna är crawling, processering, indexering och tillhandahållning av resultat. När varje fas fungerar korrekt kan sökmotorn förstå både vad din sida handlar om och hur den bör rankas i förhållande till användarens sökfråga. Det ska dock sägas att den redaktionella SEO:n har en större vikt än den tekniska, men att de till stor del är beroende av varandra för att man ska ranka högt.

Teknisk SEO påverkar alla dessa faser, men särskilt de två första: crawling och processering, där du har störst kontroll över hur väl Google kan hitta och förstå ditt innehåll.

Crawling

Crawling är den första fasen där sökmotorn hittar och läser sidor på webben. Här används program, ofta kallade spindlar eller crawlers, för att besöka webbadresser som finns i dess kö. Dessa kan komma från tidigare indexerade sidor, sitemaps eller externa länkar. Under varje besök analyserar crawlern länkarna på sidan för att upptäcka nytt innehåll och lägger dessa i kön för framtida genomsökning.

Om sidor är blockerade av robots.txt, saknar interna länkar eller laddar långsamt kan de uteslutas redan i det här steget. Därför är en korrekt intern struktur och välkonfigurerad sitemap grundläggande för att hjälpa crawlers att hitta hela din webbplats.

Processering

Processering är den fas där sökmotorn bearbetar och tolkar innehållet den har hämtat. I denna fas kör Google sidans kod (HTML, CSS och JavaScript) för att förstå hur sidan faktiskt ser ut och vilket innehåll som finns tillgängligt för användaren. Denna fas brukar ibland kallas rendering, men i grunden handlar det om att översätta koden till meningsfullt innehåll som kan analyseras.

För sidor som bygger på JavaScript sker processeringen ofta senare, i en separat renderingskö. Det betyder att nya länkar eller dynamiskt innehåll kan upptäckas först efter att sidan körts fullt ut. Sökmotorn försöker därefter förstå både text, struktur, bilder och metadata för att skapa en semantisk representation av innehållet. Denna process blir allt mer avancerad med hjälp av AI och naturlig språkförståelse (NLP) vilket i teorin bör gynna de som är experter och skriver originella texter.

Indexering

Indexering är när sökmotorn avgör vilka sidor som ska lagras i sitt index och hur de ska representeras i sökresultaten. Här analyseras bland annat sidans innehåll, metadata, språk, canonical-taggar och interna länkar. Om sidan bedöms som relevant, unik och tekniskt tillgänglig läggs den till i index.

Faktorer som kan hindra indexering är exempelvis duplicerat innehåll, noindex-taggar, redirect-loopar eller svaga signaler om kvalitet. I Google Search Console kan du se vilka sidor som har indexerats, vilka som avvisats och varför. Därför är Search Console en av de viktigaste källorna för teknisk felsökning.

Tillhandahållning

Tillhandahållning är den fas där sökmotorn presenterar relevanta resultat för användarens sökfråga. När en sökning görs försöker Google först förstå intentionen bakom frågan, det vill säga om det är en informationssökning, navigering eller ett köp, och hämtar sedan de sidor i sitt index som bäst matchar syftet. Här spelar både innehållets relevans och den tekniska kvaliteten på sidan roll.

Faktorer som laddningstid, mobilvänlighet och säkerhet (HTTPS) kan påverka hur och när sidan visas i sökresultaten. Det är också här signaler som strukturerad data och Core Web Vitals kan avgöra om ditt resultat visas med utökade element (som rich snippets eller produktdata).

Teknisk SEO:s roll i sökmotorernas process

Teknisk SEO påverkar alla delar av sökmotorernas process, men är särskilt viktig under crawling och processering. Det är här grunden läggs för hur Google hittar, läser och tolkar ditt innehåll. En webbplats som är långsam, blockerad eller fylld med duplicerade signaler kommer att få det svårt att komma till indexeringen.

Medan innehållsoptimering (on-page SEO) handlar om relevans och textkvalitet, och länkstrategier (off-page SEO) bygger auktoritet, säkerställer teknisk SEO att allt detta faktiskt går att läsa och förstå. Utan en teknisk bas blir varje annan SEO-insats ineffektiv.

Grundprinciper inom Teknisk SEO

Efter att vi förstått hur sökmotorer fungerar kan vi se att den tekniska SEO:ns roll handlar om att stödja varje fas, från crawling till tillhandahållning genom tre kärnprinciper: tillgänglighet, tydlighet och prestanda. Dessa tre pelare avgör hur väl sökmotorer och användare kan interagera med din webbplats.

De tre pelarna utgör alltså grunden för en stabil, snabb och sökbar webbplats där både människor och maskiner förstår vad som presenteras. Oavsett webbplatsens storlek eller syfte behöver varje sida kunna laddas snabbt, vara semantiskt tydlig och leverera korrekt information varje gång. Teknisk SEO handlar därför inte om att manipulera algoritmer, utan om att skapa en robust och pålitlig infrastruktur som konsekvent fungerar optimalt i alla lägen, något som i längden dessutom premieras av både användare och sökmotorer.

Tillgänglighet för bot och användare

Tillgänglighet innebär att både människor och sökmotorer enkelt kan nå och läsa ditt innehåll. Servern ska alltid svara korrekt, sidor ska vara åtkomliga via både mobil och desktop och inga viktiga delar av webbplatsen får blockeras av misstag.

Felkällor som 404-sidor, trasiga interna länkar eller felaktiga ompekningar skadar inte bara användarupplevelsen utan kan också signalera låg teknisk kvalitet till Google. En tillgänglig webbplats är helt enkelt en webbplats som alltid fungerar.

Tydlig information

Tydlig information betyder att din webbplats är logiskt strukturerad och att varje sida tydligt beskriver sitt syfte. Rubriker, metadata och intern länkning ska tillsammans berätta för sökmotorer vilket innehåll som är mest relevant och hur sidorna hänger ihop.

En tydlig informationsarkitektur underlättar inte bara för Google att förstå hierarkin mellan dina sidor, utan även för användaren att snabbt hitta det den söker. Undvik duplicerade metatitlar och metabeskrivningar och använd konsekvent HTML-semantik så att sidorna blir både maskinläsbara och begripliga för människor.

Prestanda

Prestanda handlar om hur snabbt och stabilt din webbplats laddar och reagerar. Google mäter detta genom Core Web Vitals, som fokuserar på tre nyckelområden: laddningstid (LCP), interaktivitet (INP) och visuell stabilitet (CLS).

En webbplats med god prestanda upplevs direkt som mer pålitlig, både för användare och algoritmer. Genom att optimera bilder, aktivera caching, minimera kod och använda ett modernt hosting-upplägg förbättrar du inte bara laddningstiderna utan även din chans till bättre ranking.

Core Web Vitals

Core Web Vitals är Googles sätt att mäta hur snabbt och stabilt en webbplats upplevs av användaren. För att uppnå goda resultat enligt Googles riktlinjer bör dina sidor nå följande målvärden:

- LCP (Largest Contentful Paint): Under 2,5 sekunder. Det huvudsakliga innehållet ska visas snabbt.

- INP (Interaction to Next Paint): Under 200 millisekunder. Sidan ska reagera direkt på klick, tryck och interaktioner.

- CLS (Cumulative Layout Shift): Under 0,1 sekunder. Innehållet ska inte flytta sig eller hoppa när sidan laddas.

Du kan mäta dessa värden i Lighthouse eller Google Search Console. Om dina siffror ligger över dessa gränser bör du optimera bilder, minska skriptstorlek, införa caching och se till att servern svarar snabbt.

Strukturell optimering och teknisk styrning

Teknisk SEO handlar inte bara om prestanda och indexering, utan också om hur hela webbplatsens struktur gör det möjligt för sökmotorer att förstå relationer, hierarki och prioritering. En genomtänkt arkitektur och tydliga styrfiler ger både användare och sökmotorer ett tydligt sätt att gå igenom ditt innehåll. I denna del går vi igenom de viktigaste byggstenarna för en välstrukturerad och tekniskt korrekt webbplats, som är: struktur, URL-logik, internlänkning, robots-styrning, statuskoder, sitemaps och canonical-taggar.

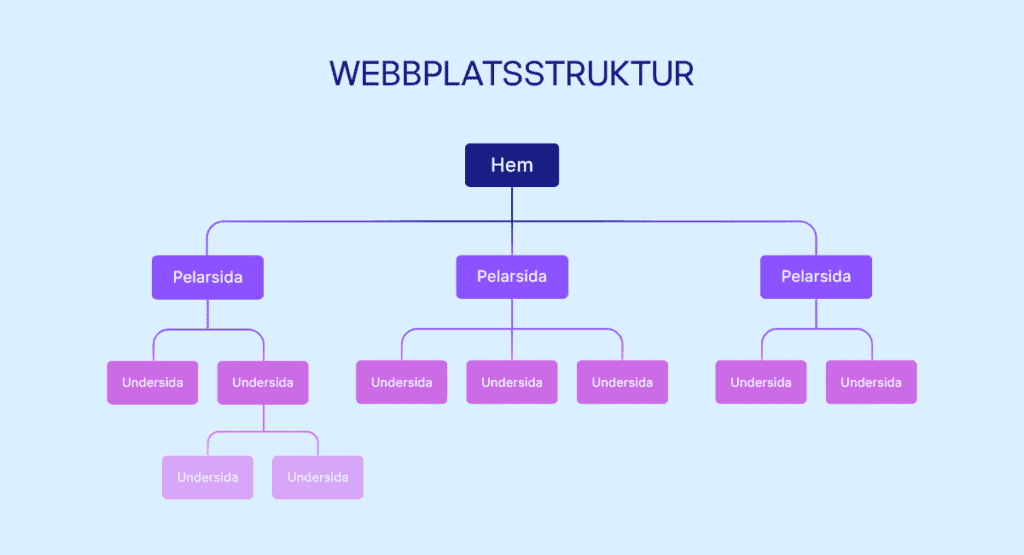

Tydlig webbplatsstruktur och URL-logik

En tydlig webbplatsstruktur gör det enklare för sökmotorer att förstå hur sidor hänger ihop och vilka som är viktigast. Struktur handlar om hur innehållet organiseras, från startsidan ner till kategorier och undersidor, och påverkar både crawling och användarupplevelse.

En bra struktur är logisk, platt och konsekvent. Platt betyder att viktiga sidor inte ligger djupt begravda, utan kan nås inom tre klick från startsidan. Djupa strukturer försvårar crawling, särskilt på större webbplatser med många nivåer.

URL-struktur

En ren och konsekvent URL-struktur underlättar både för användare och för Google. Exempel på en bra URL:

exempel.se/seo/teknisk-seo/Dålig URL:

exempel.se/index.php?id=123&category=seo&type=articleHåll URL:er korta, beskrivande och skriv alltid med gemener och bindestreck. Undvik specialtecken, parametrar och sessions-ID:n.

Breadcrumbs

Breadcrumbs (synliga navigeringsvägar) hjälper både användare och Google att förstå var i hierarkin en sida befinner sig. Google använder ofta breadcrumb-strukturen i sökresultatet, vilket ger tydligare presentationer och bättre klickfrekvens (CTR).

Internlänkning och länkflöde

Internlänkning handlar om hur sidor på din webbplats länkar till varandra. Den styr din PageRank, men också hur Google hittar och prioriterar innehåll. En bra internlänkning gör det enkelt för sökmotorn att nå alla viktiga sidor och förstå vad som hänger ihop tematiskt.

Använd en kombination av navigeringslänkar och kontextuella länkar (ankarlänkar). Navigeringslänkar (menyer och sidfötter) ger struktur, medan kontextuella länkar i texten stärker semantiska kopplingar mellan relaterade ämnen. Undvik att skapa sidor som saknar interna länkar (så kallade orphan pages). Även om Google kan hitta föräldralösa sidor genom sitemapen så är det inte rekommenderat och försvårar Googles jobb med att sätta en sida i förhållande till andra.

Länkdjup och prioritering

Ju fler klick en sida kräver från startsidan, desto mindre prioritet får den ofta i Googles crawling. För viktiga sidor som driver konvertering eller har starkt informationsvärde bör du därför säkerställa att de är länkade från flera platser och ligger “grunt” i sidstrukturen.

Robots och crawl-styrning

Robots.txt är en styrfil som talar om för sökmotorer vilka delar av webbplatsen som får eller inte får genomsökas. Filen ligger alltid i rotmappen (exempel.se/robots.txt) och läses av innan crawling påbörjas. Exempel på korrekt robots.txt:

User-agent: *

Disallow: /admin/

Disallow: /intern/

Allow: /public/

Sitemap: https://example.se/sitemap.xmlHär blockeras administrativa sidor och interna delar, medan allt under “public” är tillåtet

Viktigt att notera om robots.txt

Att blockera sidor i robots.txt hindrar inte sökmotorn från att indexera om sidan redan är känd. Om du vill hindra indexering helt ska du använda noindex-taggar i HTML-huvudet eller via HTTP-headern “X-Robots-Tag”.

Blockering = “du får inte läsa”.

Noindex = “du får läsa, men inte visa”.

Crawlbudget

Crawlbudget handlar om hur mycket resurser Google lägger på att crawla din webbplats. På små sajter är det sällan ett problem, men på stora sajter med tusentals sidor är det avgörande. En välstrukturerad internlänkning, snabba svarstider och korrekt robots-styrning gör att Google använder sin crawlbudget effektivt. Om onödiga sidor upptar mycket crawling (t.ex. filter, taggar, duplicerade varianter) kan viktiga sidor försummas.

HTTP-statuskoder och SEO

HTTP-statuskoder visar för sökmotorn hur servern svarar på en begäran. Statutskoderna är avgörande signaler som styr hur sidor behandlas i indexeringen.

| Kod | Betydelse | SEO-påverkan |

| 200 OK | Sidan finns och fungerar | Sidan indexeras som vanligt |

| 301 Permanent redirect | Sidan är permanent flyttad | Signal skickas vidare till ny URL |

| 302 Temporary redirekt | Sidan är tillfälligt flyttad | Ursprungssidan behåller signalerna |

| 404 Not found | Sidan saknas | Sidan tas bort ur index efter en tid |

| 410 Gone | Sidan är permanent borttagen | Sidan tas bort snabbare ur index |

| 500 Server error | Serverfel | Hindrar indexering tillfälligt |

Vanliga problem med statuskoder

Vid sajtflytt bör 301-redirect användas för att behålla länkstyrka. Undvik redirect-kedjor (301, till 301, till 301), eftersom de försämrar crawl-effektiviteten. 404-fel bör hanteras med anpassade felsidor som leder användaren vidare till relevant innehåll.

Test och felsökning

Använd “URL Inspection” i Google Search Console för att se vilken statuskod Google får. Verktyg som Screaming Frog hjälper dig att hitta trasiga länkar och omdirigeringar i stor skala.

SSL och HTTPS

SSL och HTTPS säkerställer att kommunikationen mellan webbplats och användare är krypterad, vilket är en direkt rankingfaktor och en signal om förtroende. Google markerar sedan länge alla HTTP-sidor som “inte säkra” i Chrome, vilket både påverkar användarupplevelsen och kan minska klickfrekvensen i sökresultatet.

För att webbplatsen ska anses säker krävs att hela kedjan är korrekt implementerad:

- Installera ett giltigt SSL-certifikat (t.ex. via Let’s Encrypt eller ett betalt alternativ).

- Tvinga HTTP mot HTTPS med en permanent 301-redirect.

- Kontrollera att sitemaps, canonical-taggar och interna länkar använder HTTPS-versionen.

- Undvik mixed content, där vissa resurser (bilder, skript eller iframes) fortfarande laddas via HTTP.

En välkonfigurerad HTTPS-struktur gör inte bara webbplatsen säkrare, den förbättrar också laddningstiden, användarnas förtroende och webbplatsens auktoritet i Googles ögon.

Sitemaps

En XML-sitemap är en fil som listar webbplatsens viktigaste sidor för att hjälpa sökmotorer att förstå strukturen och hitta nytt innehåll snabbare. Den är särskilt viktig för större webbplatser eller sajter med dynamiskt innehåll. En korrekt sitemap ska endast innehålla sidor som är indexerbara (200-svar och utan noindex). Inkludera inte URL:er som är blockerade av robots.txt eller duplicerade versioner.

Exempel på enkel sitemap:

<?xml version="1.0" encoding="UTF-8"?>

<urlset xmlns="http://www.sitemaps.org/schemas/sitemap/0.9">

<url>

<loc>https://example.se/</loc>

<lastmod>2025-10-01</lastmod>

<priority>1.0</priority>

</url>

<url>

<loc>https://example.se/seo/teknisk-seo/</loc>

<lastmod>2025-10-15</lastmod>

<priority>0.8</priority>

</url>

</urlset>För mycket stora webbplatser kan flera sitemaps användas (t.ex. en per kategori) som sedan länkas samman i en sitemap index file. Sitemaps skickas enklast via Google Search Console under “Sitemaps”.

Paginering

Paginering används för att dela upp stora mängder innehåll på flera sidor utan att förlora sammanhang eller länkstyrka. Det är vanligt på bloggar, e-handelssidor och arkiv med många listningar där varje sida visar en begränsad del av innehållet.

Om paginering hanteras fel kan den skapa problem med duplicering, försämrad crawlbudget och borttappad relevans. För att undvika det bör du:

- Använda självrefererande canonical-taggar på varje paginerad sida.

- Länka tydligt mellan sidorna med relaterad navigering (t.ex. “Nästa” och “Föregående”).

- Undvika att noindex-markera huvudpaginering eller viktiga listor.

- Säkerställa att varje sida laddar snabbt och kan nås via internlänkar.

- Hålla URL-strukturen konsekvent, t.ex. /blogg/page/2/ eller ?page=2.

Vid behov kan du också inkludera paginerade sidor i din sitemap, men endast om de har verkligt SEO-värde och trafik. För många dynamiska pagineringar kan annars slösa på crawlbudget. Korrekt hanterad paginering hjälper både användare och sökmotorer att navigera bland större innehållsstrukturer och bevarar auktoritet.

Canonical-taggar och hantering av duplicerat innehåll

Canonical-taggar används för att tala om för sökmotorer vilken version av en sida som är den primära.

När flera sidor innehåller liknande eller identiskt material kan Google annars se dem som duplicerade och sprida ranking-signalerna mellan dem. En korrekt använd canonical-tagg konsoliderar signalerna till en huvud-URL och förhindrar dupliceringsproblem.

Vad är en canonical-tagg?

En canonical-tagg placeras i sidans -sektion och pekar ut den version du vill att Google ska indexera.

Exempel för en duplicerad sida som handlar om teknisk SEO, där man vill att pelarsidan ska ses som den “riktiga” sidan:

<link rel="canonical" href="https://example.se/seo/teknisk-seo/">Om flera sidor med liknande innehåll hänvisar till samma canonical, vet Google vilken som ska representera innehållet i sökresultaten. Canonical-taggar är särskilt viktiga för e-handlare, bloggar med filtreringsalternativ eller webbplatser med flera språkversioner.

När duplicerat innehåll uppstår

Duplicerat innehåll är vanligt, även på välskötta sajter. Det kan bero på:

- Parametrar i URL:er, till exempel ?sort=pris eller ?page=2.

- Samma produkt eller artikel under flera kategorier.

- HTTPS och HTTP båda aktiva.

- Sidor som finns på både www och icke-www.

- Utskriftsvänliga versioner av samma sida.

Duplicering påverkar inte alltid rankingen negativt, men gör att Google måste välja vilken version som ska visas. Det kan i sin tur späda ut auktoriteten och försämra synligheten.

Själv-refererande canonicals

Varje sida som man vill ska vara den primära sidan bör ha en själv-refererande canonical, alltså en tagg som pekar till sig själv. Det gör att sökmotorer tydligt förstår vilken URL som är huvudversionen, även när det bara finns en.

Exempel till sidan som handlar om internlänkning:

<link rel="canonical" href="https://example.se/seo/internlankning/">Detta är en enkel men ofta förbisedd detalj som ökar indexeringsstabiliteten och att rätt sida visas för det man vill ranka för.

Canonical vs noindex vs redirect

Det är viktigt att förstå skillnaden mellan dessa tre metoder eftersom de används i olika syften:

| Metod | Funktion | Används när | Effekt |

| Canonical | Visar vilken version som är huvudversion | Flera sidor med liknande innehåll ska konsolideras | Alla signaler går till den kanoniska URL:en |

| Noindex | Hindrar en sida från att synas i sökresultat | Innehåll ska finnas kvar men inte indexeras | Tas bort ur index, men kan fortfarande crawlas |

| 301 Redirect | Flyttar sidan permanent | Innehållet ska ersättas helt | Länkstyrka flyttas till den nya URL:en |

Canonical och språkversioner (hreflang)

Varje språkversion ska ha en egen canonical som pekar till sig själv och sedan länkas ihop med övriga språkversioner via hreflang-taggar. Det förhindrar att Google ser översatta sidor som duplicerade.

Exempel:

<link rel="canonical" href="https://example.se/seo/teknisk-seo/">

<link rel="alternate" href="https://example.com/en/technical-seo/" hreflang="en">

<link rel="alternate" href="https://example.se/seo/teknisk-seo/" hreflang="sv">Vanliga misstag med canonical-taggar

- Felaktiga domäner: Canonical pekar till en annan domän.

- Kedjor: En sida pekar till en annan canonical som pekar till en tredje.

- Självreferens saknas: Ökar risken att Google väljer fel version.

- Motstridiga signaler: Canonical till en URL men 301-redirect till en annan.

- Pekar på icke-indexerbara sidor: Google ignorerar canonical om målet är blockerat.

Kontrollera alltid canonical-taggar via Google Search Console eller “Inspect URL”.

Tunna sidor

Tunna sidor är sidor med för lite, för svagt eller för duplicerat innehåll för att tillföra verkligt värde för användaren. De utgör ett av de vanligaste kvalitetsproblemen inom teknisk SEO eftersom de dränerar crawlbudget, försvagar den interna länkstrukturen och kan få hela webbplatsens ranking att sjunka.

Exempel på tunna sidor inkluderar:

- Produkt- eller kategorisidor med nästan identiska beskrivningar.

- Tagg- och filtreringssidor utan unikt innehåll.

- Blogginlägg med få ord och utan kontext.

- Landningssidor som bara duplicerar text från andra delar av sajten.

För att hantera tunna sidor kan du:

- Slå ihop flera tunna sidor till en stark, samlad resurs.

- Förbättra innehållet med mer text, bilder, tabeller eller strukturerad data.

- Exkludera sidor utan värde med noindex.

- Analysera regelbundet i Google Search Console för att identifiera sidor med låg trafik och kort genomsnittlig sessionstid.

En webbplats med många tunna sidor signalerar låg kvalitet till Google – medan en sida med färre, mer omfattande och relevanta resurser stärker din topical authority och förbättrar indexeringens effektivitet.

Bild- och mediaoptimering

Bild- och mediaoptimering handlar om att minska laddningstiden och öka tillgängligheten utan att försämra kvaliteten. Eftersom bilder och andra mediafiler ofta står för majoriteten av en sidas totala filstorlek är de avgörande för både Core Web Vitals och användarupplevelsen.

Optimering för hastighet:

- Komprimera bilder med moderna format som WebP eller AVIF.

- Ange alltid bilddimensioner (width/height) i koden eller CMS-editorn för att undvika layout-skift (CLS).

- Använd lazy loading för att ladda bilder och videor först när användaren faktiskt når dem i vyn. Detta minskar initial laddningstid dramatiskt.

- Implementera CDN (Content Delivery Network) så att bilder och andra resurser levereras från en server nära användaren. Ett CDN kan minska laddningstiden globalt med flera sekunder.

Optimering för sökmotorer:

- Alt-taggar beskriver bildens innehåll och hjälper Google att förstå sammanhanget. Det är även en tillgänglighetsfaktor för skärmläsare och ett lagkrav numera.

- Filnamn bör vara beskrivande och relevanta, t.ex. teknisk-seo-analys.webp i stället för IMG_1234.jpg.

- Strukturerad data för bilder (ImageObject) kan användas vid produkt- eller artikelbilder för att förbättra synlighet i sökresultaten.

Fördelar med optimerade bilder och mediaobjekt

Rätt hanterade bilder gör inte bara webbplatsen snabbare, de stärker också indexering, tillgänglighet och användarupplevelse. Det är dessutom en av de lättaste tekniska åtgärderna att utföra.

Grundläggande SEO-element som alltid bör finnas

De grundläggande SEO-elementen säkerställer att varje sida på din webbplats kan förstås, indexeras och rankas korrekt. Detta är det första du bör kontrollera i varje teknisk SEO-granskning, oavsett webbplatsens storlek eller komplexitet.

De element med störst påverkan är:

- Metatitel (titel-tagg): Beskriver sidans syfte och ska vara unik, tydlig och innehålla primärt sökord.

- Huvudrubrik (H1): Speglar titeln och hjälper både användare och sökmotorer att förstå sidans huvudämne.

- Mobilanpassning (Mobile-first): Google indexerar i första hand mobilversionen av din webbplats. En responsiv design med snabb laddningshastighet och tydlig navigering i mobilversionen är därför kritisk för synlighet och ranking.

- Canonical URL: Anger vilken version av sidan som är den primära för indexering.

Om dessa element saknas eller är felaktiga får sökmotorer svagare signaler om vad sidan handlar om, vilket kan leda till sämre ranking eller felindexering. När de däremot används konsekvent skapas en tydlig struktur som gör att både användare och Google uppfattar sidan som relevant och professionell.

Prioritering i tekniskt SEO-arbete

Att kunna prioritera rätt i sitt tekniska SEO-arbete är ofta skillnaden mellan en effektiv löpande strategi och ett evighetsprojekt som bromsar allt annat SEO-arbete. Alla tekniska fel har inte samma påverkan och det är därför viktigt att arbeta strukturerat utifrån potential, påverkan och resursåtgång.

1. Börja med det som påverkar indexering

Det första steget är att säkerställa att sökmotorerna kan nå, läsa och indexera allt viktigt innehåll. Det innebär att kontrollera:

- Robots.txt

- Noindex-taggar

- Canonicals

- HTTP-statuskoder

- Sitemap-struktur

Om sidor inte indexeras korrekt spelar inget annat arbete någon roll.

2. Åtgärda de mest synliga problemen för användaren

Nästa steg är att förbättra prestanda och tillgänglighet. Fokus ligger på:

- Laddningstid (Core Web Vitals)

- Mobilanpassning

- Säkerhet (HTTPS)

- Felaktiga länkar eller trasiga omdirigeringar

Detta är ofta åtgärder som ger snabba resultat både i ranking och i användarupplevelse.

3. Stärk kvalitet och struktur

När grunden fungerar är det dags att optimera det interna flödet:

- Internlänkning

- URL-struktur

- Breadcrumbs

- Hantering av duplicerat innehåll

- Förbättring av tunna sidor

Detta ökar webbplatsens “crawl-effektivitet” och stärker topical authority.

4. Finjustera för prestanda och skalbarhet

Sist handlar det om att bygga för framtiden. Här bör man titta på:

- CDN och caching

- Lazy loading och scriptoptimering

- Schema markup

- Serverprestanda och hostinglösning

Dessa förbättringar ger långsiktig stabilitet och hög teknisk kvalitet.

5. Arbeta iterativt

Teknisk SEO är ingen engångsåtgärd, det bör ske i kontinuerliga cykler: upptäck, åtgärda, verifiera och utvärdera. Verktyg som Google Search Console, Screaming Frog och SE Ranking Website Audit hjälper dig att löpande identifiera tekniska hinder och mäta förbättringar.

En effektiv teknisk SEO-strategi handlar inte om att göra allt samtidigt, utan om att göra rätt saker i rätt ordning.

Verktyg och resurser för teknisk SEO

Verktyg för teknisk SEO hjälper dig att identifiera, analysera och övervaka tekniska problem på din webbplats. Att arbeta systematiskt med rätt verktyg sparar tid, ökar precisionen och gör det möjligt att prioritera rätt åtgärder.

1. Google Search Console

Google Search Console (GSC) är det mest grundläggande verktyget, och dessutom gratis för alla att använda. Här kan du:

- Se vilka sidor som är indexerade eller blockerade

- Se rapporter om Core Web Vitals och mobilanpassning

- Se eventuella problem med strukturerad data

- Se täckningsrapporter för att upptäcka 404-fel och noindexade sidor

GSC är perfekt för löpande hälsokontroll och prioritering.

2. Google PageSpeed Insights & Lighthouse

Analysera sidans prestanda, både för mobil och desktop. Google PageSpeed & Lighthouse ger konkreta rekommendationer för förbättring av laddningstid, renderingshastighet och Core Web Vitals.

3. Screaming Frog SEO Spider

Ett kraftfullt verktyg för att crawla hela webbplatsen. Screaming Frog identifierar trasiga länkar, duplicerade titlar, felaktiga canonicals, statuskoder och mycket mer. Ett perfekt verktyg för att simulera hur Google uppfattar din webbplats rent tekniskt.

4. SE Ranking Website Audit

Automatiserade audits som kombinerar teknisk analys med länkinsikter. SE Ranking visar tekniska fel, prioriteringsnivåer och historiska förändringar över tid.

5. Cloudflare / CDN-verktyg

För webbplatser med hög trafik är ett CDN som Cloudflare eller Akamai ett måste. Det förbättrar laddningstid, säkerhet (via SSL/TLS) och skyddar mot DDoS-attacker, vilket också påverkar SEO indirekt genom stabilitet och tillgänglighet.

6. Schema.org / Structured Data Testing Tool

Används för att testa och verifiera strukturerad data (schema markup) för produkter, artiklar, recensioner m.m. Strukturerad data är inte en direkt rankingfaktor, men påverkar synlighet i SERP:en genom rich snippets och gör det lättare för AI-bottar att söka igenom och hämta innehåll.

7. Logganalysverktyg (för stora sajter)

För mycket stora sajter är logganalys avgörande för att förstå hur Googlebot faktiskt beter sig. Verktyg som Screaming Frog Log File Analyser eller Oncrawl visar vilka sidor Google besöker, hur ofta och med vilket resultat. Viktigt för att optimera crawlbudget och upptäcka dolda problem.

8. CMS-plugins och automatisering

För WordPress, Shopify och liknande finns SEO-plugins som Yoast SEO, Rank Math eller All in One SEO som förenklar grundläggande optimering, canonical-hantering och metataggar. Kombinera gärna dessa med caching- och bildoptimeringsplugins (t.ex. WP Rocket, ShortPixel) för bättre Core Web Vitals.

Sammanfattning

Teknisk SEO handlar i grunden om att bygga en webbplats som är snabb, stabil och begriplig, både för människor och för sökmotorer. När den tekniska grunden fungerar som den ska blir resten av SEO-arbetet enklare, effektivare och mer lönsamt. Det handlar inte om att göra allt på en gång, utan om att se till att det viktigaste fungerar som indexering, prestanda och struktur.

På Pimiento arbetar vi med SEO som en helhet, från teknisk analys och struktur till innehåll, strategi och tillväxt. Vi ser till att din webbplats fungerar optimalt i varje detalj och att din SEO-strategi bygger på fakta, erfarenhet och långsiktig effekt.

Vill du veta hur din webbplats kan prestera bättre? Hör av dig till oss så berättar vi hur.